Estaba releyendo el artículo que me mandó un buen amigo tiempo atrás, se llama El desafío de ser humano en la época de la inteligencia artificial, escrito por Henry Kissinger, Eric Schmidt y Daniel Huttenlosher. Schmiddt fue CEO de Google y presidente de Alphabet, mientras Huttenloscher es decano de un colegio del MIT. Me llama la atención que un artículo tan corto haya requerido de tres autores tan famosos ¿Lo habrán escrito realmente o solo pusieron el nombre para darle lustre a la cosa? Quien lo sabe, pero parece evidente que quisieron presentar la idea con un espaldarazo de autoridad muy fuerte y que nadie dudara de lo que decía.

El tema del artículo no es muy novedoso, se trata de advertencias sobre el impacto ético, en temas de privacidad y cosas así que puede tener el uso de la inteligencia artificial en cada vez más aplicaciones. La idea central es que la inteligencia artificial se estaría acercando cada vez más a la inteligencia humana, lo que produce el peligro que las máquinas puedan decidir demasiado y hasta "pensar" por si mismas, sin la intervención de las personas.

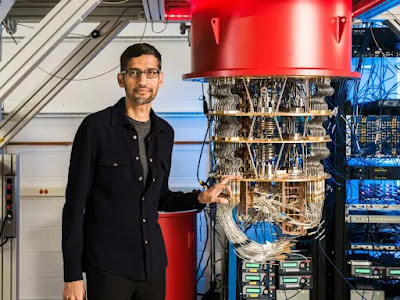

Se pone como ejemplos algunas aplicaciones, como el programa AlphaZero de Google, que aprendió ajedrez de manera automática y que -según el gran maestro Gary Kasparov- "sacudió hasta sus raíces" el juego por su enfoque totalmente nuevo para jugar. No hay que olvidar que hace muchos años la máquina Deep Blue de IBM le había ganado a Kasparov, entonces campeón mundial.

También se mencionan otras aplicaciones como los traductores automáticos, el desarrollo de moléculas y antibioticos y el procesamiento masivo de textos de Internet, que permitía "pasar la prueba de Turing", que se le ocurrió a Alan Turing para definir si un computador puede o no ser considerado "inteligente".

La prueba de Turing es ingeniosa y lo suficientemente sencilla como para que la podamos explicar muy superficialmente: imaginemos que podemos hacer preguntas por un buzón o lo que sea y nos sean contestadas. Podemos preguntar lo que se nos antoje, algunas las contesta una máquina y otras un ser humano. Si no podemos distinguir si estamos hablado con una máquina o con una persona entonces la máquina habrá pasado la prueba de Turing y podríamos decir que tiene inteligencia

Es cierto que hoy existen chatboxes, capaces de engañar a las personas, que piensan estar hablando con alguien, cuando en realidad lo hacen con un programa. Y es una tecnología que cada día se afina más, pero la prueba de Turing tiene varios puntos débiles y como está hoy la tecnología creo que no es suficiente para que podamos calificar algo como "inteligente". Me parece que el "aprendizaje profundo", que es la base de todas esas tecnologías es un asunto bastante mecánico y muy alejado a lo que conocemos como inteligencia.

Por esas casualidades de la vida, justo mi amigo Tito Torres me mandó el libro La mente nueva del emperador, del matemático Roger Penrose, que colaboraba con Hawkings y creo se ganó el Premio Nobel. El libro es algo enredado, no está muy bien escrito pero es comprensible, lo que no es poca casa para un matemático, que tienen fama de ininteligibles.

El asunto es que Penrose desarrolla muy bien los temas de la inteligencia artificial en su concepto fuerte y en su concepto débil. La IA fuerte propone que la mente humana funciona de un modo básicamente mecánico, en base a experiencia, algoritmos y lógica. Así que es cuestión de tiempo que los computadores empiecen a pensar por si mismos, bastará con tener la capacidad de almacenamiento y la velocidad suficiente y podremos hacer un computador con el cerebro de Einstein, Beethoven o quien sea.

Eso es más o menos lo que anuncia el artículo de Kissinger y los otros del que hablaba al principio, inclusive va más allá, prediciendo que en poco tiempo más ya tendremos máquinas de aprendizaje profundo que no seremos capaces de controlar.

Pero Penrose y otros están muy lejos de esa idea. Sin desconocer que parte de la mente humana se basa en la lógica y el razonamiento mecánico, existen otros componentes que van mucho más allá de eso.

No basta con que una máquina haga creer a alguien que es un ser humano para que podamos calificarla de inteligente, más que eso, que es una habilidad mecánica como hacer cálculos, tomar decisiones lógicas o hacer traducciones automáticas, hay otras componentes de la inteligencia que todavía están muy lejos del alcance de una máquina.

Muchos de los que hablan de inteligencia artificial nunca han escrito código, así es que simplemente extrapolan. Toman algo que ha crecido mucho en poco tiempo, como las capacidades de memoria y cálculo de las máquinas y tiran una línea recta hasta el futuro, pensando que seguirá creciendo infinitamente.

También le asignan propiedades casi mágicas a los algoritmos, suponiendo que no hay cosa en el mundo que no se pueda entender como una lista de procedimientos. Usan buzzwords como "Big data" "Deep learning" y cosas del estilo como conjuros de magia negra que todo lo pueden. Tonteras, estamos a años luz de que una máquina pueda tener conciencia. De hecho ni siquiera entendemos lo que es la conciencia ¿y se va a crear en una máquina programada por el hombre? Vayan a lavarse más mejor.

No entiendo por qué se escribió ese artículo y con esos autores. Me late que quieren vender algo, no se, pero me parece que tiene un gato encerrado. El día que aparezca una máquina capaz de ser genuinamente estúpida, entonces recién creeré que la inteligencia artificial podría existir algún día.

Hola Tomás, una de las críticas al Test de Turing es el experimento de la Habitación China de John Searle que ataca precisamente el concepto de IA dura. Este filósofo dice que los computadores funcionarían como una habitación cerrada con un orificio en la puerta, con el filósofo metido adentro con un manual para escribir en chino. La gente de afuera le escribe en chino preguntas que meten en el orificio y Searle las contesta con el manual sin tener idea de chino. Conclusión: la máquina funciona pero no entiende idea de chino. Hay un montón de discusiones y teorías que justifican y critican este experimento. Creo que Penrose lo ha popularizado criticándolo al mismo tiempo.

ResponderBorrar¿Si no comprendemos nuestra propia naturaleza, como vamos a replicarla? Estamos atrapados en nuestra jaula biológica y percibimos el universo a través de nuestros sentidos, filtrados y procesados por nuestro cuerpo, (no solo el cerebro) en formas que la ciencia no entiende.

ResponderBorrarHemos construido artefactos como el raciocinio y la matemática que han llegado a niveles casi incomprensibles de abstracción, pero al final están basados en el pensamiento humano, a mi ver inadecuado para explicar nuestra propia naturaleza.

La idea que una inmensa calculadora va a adquirir sensibilidad y conciencia de sí mismo solamente demuestra la prepotencia humana. Máquinas operando dentro de rígidos parámetros predefinidos, como el "Big Blue" son respuestas mecánicas, este no es inteligencia.

Basta usar Google Voice para conocer las limitaciones de esta implementación de "Estupidez Artificial".

Hola Ricardo, en el libro de Penrose que puse el link. él explicaba latamente lo de la Habitación China y la verdad es que yo no terminaba de entender cual era el argumento, con tu explicación me queda mucho más claro, es un problema de muchos científicos eso de no redactar claramente. Claro, la base del asunto es que las máquinas pueden hacer tareas sin estar conscientes de su significado. Hay cosas que una máquina con algoritmos puede emular muy bien, como las cosas lógicas, razonables, que siguen la causalidad siempre es decir mecánicas, pero otras como la locura, la estupidez, los sentimientos, la intuición -que no son defectos sino la parte más importante de la inteligencia, lo que nos diferencia de los gatos- no veo como se podrían modelarse con algoritmos, a lo más se podrían simular. Por eso la estupidez artificial me parece tan importante.

ResponderBorrarJuan, si, hay mucha arrogancia y también ignorancia en esas extrapolaciones. Muchos hacen esas suposiciones en frío, sin haber escrito una sola línea de código en su vida (debe ser el caso de Kissinger por ejemplo), entonces no tienen idea de las limitaciones de cualquier algoritmo.

El "aprendizaje profundo" por ejemplo, se le da exagerada importancia, pero resulta que no deja de ser algo mecánico. Todos los que alguna vez estudiamos o hicimos clases de algo sabemos que existen muchas habilidades y destrezas que no pueden ser aprendidas, las traemos de fábrica y cada uno tiene su set de cosas en las que es hábil y otras en la que es intrínsecamente inútil. Si las habilidades fueran mecánicas, todos las tendríamos por igual y el que haya sido profesor alguna vez sabe que no es así.

Alguien puede vencer sus limitaciones hasta cierto punto: yo soy naturalmente malo para las matemáticas pero en la U terminé siendo ayudante, sin embargo siempre he estado claro que tengo un techo -y bien bajo- en esas cosas, tal como en el baile, la música y muchas otras cosas.

En cambio se me da fácil redactar. Alguien que sea mecanicista podría decir que eso es porque he leído mucho, pero ni tanto, algo tiene que ver en los detalles, pero básicamente la redacción siempre me ha salido sola y sin esfuerzo. Creo que esas habilidades que no solo se basan en un entrenamiento mecánico son parte de las muchas cosas que no se pueden conseguir con algoritmos.

Otro ejemplo que se me ocurre al paso es la inutilidad total de las "escuelas de negocios". Es imposible enseñar a alguien a ser hábil en los negocios, apenas se le puede enseñar a administrar. Por eso los que estudian negocios pueden ser administradores competentes pero pueden ser pésimos haciendo negocios, ya sabemos eso de los premios Nobel de economía que nunca han ganado otra plata que su sueldo de profesores y cuando han intentado hacer negocios se van en puros fracasos

ResponderBorrarComo mero lector analfa veo que las opiniones y pronosticos van desde un par de años a un par de siglos para que la IA nos supere y adquiera lo que llamamos conciencia de si.

ResponderBorrarEn todo caso, ya nos supero, y por muy lejos, en areas que suponiamos "ultra inteligentes"; Alphazero no solo supero a campeones de go, sino a programas previos que los habian derrotado, pero el aparato aprendio solo, desarollo estrategia no descritas hasta ese momento y se las arreglo para no examinar millones de opciones en cada jugada sino supo discriminarlas, desechando caminos e imaginando otros. Ok, no es "inteligencia", pero si es una de sus caracteristicas principales.

Como causalista estricto, no dudo que se podra llevar, algun dia, a una maquina la actividad de la maquina humana. La otra opcion es creer que hay un fantasmita detras de la maquina humana (Pinker), y seria irreproducible.

Pero el tema es mucho mas cercano, poe ejemplo el reconocimiento de rostros yla exploracion de bases de datos casi infinitas de actividad humana permiten ya una sociedad orwelliana; Si le sumas el uso de drones que reconocen enemigos en una multitud y son capaces de "decidir" actuar, cosa que no reconocen, pero apuesto un chicle usado a que ya estan operativos. Mas cercano y de uso creciente en diagnosticos medicos, y como ayuda legales, en periodismo si no los usan como redactores, estan apunto.

Hay una pelicula llamada "Ex-Machina" en la que un chico es invitado a la casa del dueño de la compañía para la que trabaja y es seleccionado para realizar un test de Turing a una ginoide. en el proceso las cosas se vuelven inquietantes para el chico ya que se da cuenta que cada prototipo evolucionaba casi al punto de ser Humano.

ResponderBorrarMuchas de las películas Sci-Fi han predicho con mucha antelación la evolucion de lo que llamamos "Inteligencia Artificial" al punto de volverse autónoma, pero falta mucho para que se llegue a la creación de una que pueda equipararse al cerebro humano.

Las máquinas basan su "pensamiento" en el codigo binario (0-1), creado por las decisiones que un ser humano tomaría (Si-No, Blanco-Negro, Arriba-Abajo, etc.), pero de que haya una máquina autoconsciente de su existencia, eso no lo sabemos todavia.

Me hiciste recordar la frase de Carl Icahn, inversionista multimillonario gringo que sigo hace años.

ResponderBorrarEl dice “Mucha gente trata de ganar dinero usando la inteligencia artificial. Yo me he hecho rico estudiando la estupidez natural”.

Parece que funciona. 16.000 millones de dólares lo avalan.

¡Gran frase jajaja!

ResponderBorrarY tiene mucha verdad

Wilson, si se que eres un maldito causalista! Yo creo que una misma causa puede tener diferentes efectos, incluso bajo idénticas condiciones. Pero en fin, son creencias de uno no más, es como discutir si existen o no los platillos voladores tripulados por extraterrestres, quien puede saberlo.

ResponderBorrarEs cierto que hay algunas aplicaciones de la llamada "inteligencia artificial" que plantean nuevos problemas, pero creo que en genral es algo que pasa con toda tecnología nueva, por ejemplo la ingeniería genética. No creo que sea como para aterrorizarse tampoco, los problemas son para resolverlos.

Si José hay mucha especulación en la ciencia ficción sobre eso, pero yo creo que estamos muy muy lejos todavía. Muchas de estas especulaciones podrían ser interesadas y estar cubriendo algunos intereses o ideologías políticas. Eso me explicaría leer a Kissinger, que poco tiene que decir, pontificando sobre el asunto

Es-Machina es buena pelicula, me gustó. Sin saber realmente, habiendo escuchado "Inteligencia Artificial" desde que estaba en la Facultad y nunca llegamos a eso, soy incrédulo.

ResponderBorrarHace décadas lo relacionaban con la acumulación de chips: cuando se llegara a poner en un integrado tantos como neuronas tiene el humano, vualá ! Pero seguro superaron ese número y no pasó.

El cerebro animal, por supuesto el humano, es un sistema nervioso sofisticado durante millones de años con el objetivo de hacer sobrevivir al individuo portador. Tiene un objetivo clarìsimo. Llegar a la conciencia y a la representaciòn del mundo lo hace para preservarse a sí mismo. Las máquinas son inventos de los humanos para cumplir un fin ajeno a los "intereses" de la máquina misma. Es una forma de "inteligencia" muy distinta a la animal, sospecho que no pueden converger en el mismo tipo de cerebro. Eso no quiere decir que algunos autómatas no nos puedan superar cada vez más en cada vez más tareas y habilidades, es otra cosa. Uls

Si Ulschmidt, eso de extrapolar los avances de los últimos 50 qños está muy bien, pero el cerebro lleva varios millones de años desarrollándose. Como comentaba Juan yo veo una tremenda arrogancia en todo esto y una falta de sentido de escala. Cualquier clase de "inteligencia" de una máquina no responde -tal como dices- a los intereses de la máquina, sino a los del que la hizo. Se especula montones con eso de que las máquinas llegarán a tener sus propios intereses y todo eso, yo no lo creo, como tampoco creo que el pensamiento sea solo un encadenamiento de causas y efectos bien determinados, previsibles y sujetos a reglas.

ResponderBorrarSobre superar habilidades humanas n que decirlo, la más sencilla de las calculadoras, que hace las 4 operaciones, potencias y raíces, supera con mucho la capacidad de cálculo de cualquier ser humano.

Don Tomas,

ResponderBorrarEn mi área de la Ingeniería, los programas son cada vez más complejos lo que los hace menos simples y a la vez enredados para llegar a una solución básica y de allí a mejorarla para optimizarla. Vivimos en una era de herramientas computacionales que mas dificultan que simplifiquen. Por ejemplo Autodesk posee numerosos programas con Mas, Mas, Mas y ahora con el sistema de nube que pareciera el gran recipiente de ideas y estudios e información clasificada pero hay cosas básicas que uno quisiera poseerla en su programa básico, Autocad. Que sea paramétrico en los ejes x,y ,z .Esto NO lo hacen porque inventor queda cesante… Un ejemplo de la no simplificación.

Leí mucho tiempo atrás el libro Chock del futuro que trata de un individuo que vive cada vez mas angustiado porque la una velocidad de cambio de tecnologías es mayor a su velocidad de aprendizaje. Pienso que eso es lo que estamos viviendo. La estupidez de tener lo ultimo y no discriminar lo que es esencial para solucionar los problemas en forma simple y de ahí encaminarse a lo óptimo y eso se traduce en un “Chock”

Para mi entender La IA no es más que RA, ”Raciocinio Artificial” es decir toma de decisiones frente a varias opciones nada más. La toma de decisiones siguiendo una pauta de virtud puede lograr “genialidades” que la maquina no posee. La mente humana que integra la espiritualidad con la razón es inmensamente poderosa y no la sabemos usar.

Basta estudiar un libro de pensamiento matemático para darse cuenta que el potencial de nuestra mente es inmensa.

Aquí está el link de los dos libros:

http://ciudadanoaustral.org/biblioteca/06.-Alvin-Toffler-El-shock-del-futuro.pdf

https://visaldiary.files.wordpress.com/2011/07/secrets-of-mental-math.pdf

Centurio, es muy buena esa definición "raciocinio artificial", me gustó mucho y -como dices- está muy lejos de la inteligencia.

ResponderBorrarMuchas gracias por los link, los estaré chequeando